環境資訊中心綜合外電;黃鈺婷 編譯;林大利 審校

本站聲明:網站內容來源環境資訊中心https://e-info.org.tw/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※超省錢租車方案

※別再煩惱如何寫文案,掌握八大原則!

※回頭車貨運收費標準

※教你寫出一流的銷售文案?

※產品缺大量曝光嗎?你需要的是一流包裝設計!

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

0L售價不到9萬元,而且作為一台豐田的硬派越野車,其可靠性之高是毋庸置疑的。只是作為一款十多年的老車,它將會面臨嚴峻的年檢考驗,甚至被納入黃標範圍無法上路。不過如果你已經有一台代步車,那麼買一台這樣的經典硬派越野車,只用作純粹的越野撒歡之用,其實也是挺不錯的。

10萬元以內,買什麼車好?很多年輕消費者都會在10萬元上下的價格區間選擇自己的第一台車,而很多時候他們都會把選擇範圍局限本田飛度、大眾polo、寶駿510這樣的熱門車型,但是如果我們將目光投向二手市場,也許我們會有驚喜發現哦!

MINI One 1.6L

MINI可以說是目前國內形象最個性最時尚的品牌之一,在目前的二手市場上,行駛里程在10萬公里左右的2011款MINI One售價約在9到10萬元,小巧個性的造型和動力表現還不錯的1.6L自然吸氣發動機很適合在城市作日常通勤用車。不過需要注意的是,雖然油液、濾芯等消耗品的常規保養項目成本不高,但MINI的零部件價格較高,一旦需要更換零件,還是需要花不少錢的。

薩博 9-5

一個當年以其飛機生產商出身而自豪的瑞典品牌,薩博9-5毫無疑問是一款極其獨特的中大型轎車。由於車型極其冷門,目前二手市場上哪怕是搭載高功率版本2.3T發動機的薩博9-5 Aero,售價也不過10萬元;不過車源稀少且市面上配件難找,後期維護保養比較麻煩。

克萊斯勒300C

如果說國內還有哪些車擁有典型的美式風格,那麼克萊斯勒300C毫無疑問是其中之一;平直的線條,巨大的鍍鉻中網,大尺寸輪圈和3.6L自然吸氣V6發動機,克萊斯勒如此“肌肉化”的外觀設計肯定會引來不少路人的目光。目前二手市場上的舊款克萊斯勒300C大多是較早的2004款車型,行駛里程都在10萬公里以上,售價在8到9萬元左右。對於這款典型的美式轎車,選擇它就意味着需要做好面對驚人油耗的準備。

豐田普拉多

除了每天的城市穿梭,當然也會有一部分人想要在閑暇時開着車到野外撒歡,那麼一台強大的越野車就是必不可少的穿越工具。豐田蘭德酷路澤系列的普拉多車型就是個不錯的選擇。目前二手市場上一台2001款的豐田普拉多4.0L售價不到9萬元,而且作為一台豐田的硬派越野車,其可靠性之高是毋庸置疑的;只是作為一款十多年的老車,它將會面臨嚴峻的年檢考驗,甚至被納入黃標範圍無法上路;不過如果你已經有一台代步車,那麼買一台這樣的經典硬派越野車,只用作純粹的越野撒歡之用,其實也是挺不錯的。

日產奇駿

當然,如果你需要一台平時也能用來代步的越野車,那麼2010款的日產奇駿就能幫到你了。目前市面上行駛里程在10萬公里左右的2010款日產奇駿,售價普遍在9萬元上下。

斯巴魯森林人

而除了日產奇駿之外,10萬元預算甚至能在二手市場找到一台2008款的斯巴魯森林人2.0XS!水平對置發動機搭配強大的全時四驅系統,斯巴魯森林人就是一款通過性出色,而且形象更加高檔的優秀SUV車型。

豐田凱美瑞

那麼如果你性格成熟穩重,而且想要更多的估計家庭需要,甚至想要有一些商務范,豐田凱美瑞就是個很不錯的選擇。10萬元預算,能夠在二手市場上找到車況不錯的舊款凱美瑞,2011款到2013款都有非常豐富的車源,能夠慢慢從中挑選車況優秀、價格合理的車源。

本田奧德賽

MpV是非常出色的家用車型,目前,只需10萬,就能買到一台行駛里程在10萬公里以內的舊款奧德賽。本田奧德賽是一款非常成功的家用MpV車型,由於舊款造型比較接近旅行車,奧德賽的外觀看上去不會顯得太過商務化,自己平日里開着上班也不會有濃重的“司機范”。

斯巴魯翼豹

說到激情,說到玩樂,有興趣的朋友可以在市場上尋找一下斯巴魯翼豹的身影,目前市面上價格在10萬元以內的斯巴魯翼豹大多是搭載EJ20自然吸氣發動機和手自一體變速箱的版本,因此購買后還需多花點心思在後期改裝部分,才會體現出斯巴魯翼豹的“好玩”之處。

寶馬1系

156馬力的2.0L發動機,前置后驅布局,再搭配出色的6擋手動變速箱,舊款寶馬1系的駕駛樂趣是相當高的。目前二手車市場價格只需要8到9萬元,性價比可謂相當高。

買車不一定都要買新車,尤其是對於年輕一代消費者來說,二手車甚至能以低廉的價格找到更加有趣的車型,上面提及的這些車不過是二手市場中好車群里的冰山一角。不過畢竟二手車的車況參差不齊,有意選擇二手車的朋友也要注意先了解清楚試車、驗車的竅門哦!本站聲明:網站內容來源於http://www.auto6s.com/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※教你寫出一流的銷售文案?

我們再一起來回顧一下吧現代ENCINO是一款以性能著稱的小型SUV,搭載1。6T渦輪增壓發動機和雙離合器變速箱作為動力總成,177匹馬力的賬面參數也是十分誘人,配合上個性張揚的外觀設計和尚且不貴的售價,現代ENCINO要成為未來年輕人的首選車型的決心顯而易見。

《後來的我們》上映不久票房已超過10億,

繼《前任3》后又再一次給了年輕人5條建議:

1.如果結婚就要找愛你的

2.千萬別輸在“等”這個字身上

3.永遠留住30%的神秘

4.如何才能配得上你的伴侶?

關注玩車是

走向人生巔峰迎娶白富美嫁給高富帥的前提噢!

5.牢記第4條,前3條沒什麼用…

好吧,皮了一下,我們說回正事吧

看看了5月或將上市的車,

心想:除了個別車型,毫無驚喜!

這跟4月份的新車比起來,差距可不是一點點啊

起碼,全新的SUV,就有6款重磅新車了

不是改款,不是換代,

這幾款都是扎紮實實的新車、新SUV噢!

我們再一起來回顧一下吧

現代ENCINO是一款以性能著稱的小型SUV,搭載1.6T渦輪增壓發動機和雙離合器變速箱作為動力總成,177匹馬力的賬面參數也是十分誘人,配合上個性張揚的外觀設計和尚且不貴的售價,現代ENCINO要成為未來年輕人的首選車型的決心顯而易見。

威馬EX5是一款非常具有市場潛力的電動SUV,雖然是新品牌下的新車型,但是威馬公司背後的技術背書和他們自建工廠的生產方式讓他們的品牌形象顯得十分靠譜。而威馬EX5的實車已經正式上市,在2018年下半年就可以正式交付,EX5的設計非常符合大眾審美,屬於十分耐看的一款車型,而且續航里程可以達到400多公里的動力特性,也讓它十分有成為一二線限行城市的熱銷車型的潛力。

自主品牌非承載式SUV對於普通消費者來說更像是一個要麼廉價,要麼粗糙的存在。但是榮威RX8的上市便打破了這一種的傳統認知,榮威RX8的非承載式SUV和全時四驅的特性讓它有着比較出色的越野能力,而且定位豪華的RX8在內飾氛圍的設計上融入了非常多的木紋飾板和檔次感出眾的軟質材料,讓整車的檔次感顯現地非常到位。

對於越野有需求的消費者,或許就在途達上市以後有了新的選擇,非承載式車身,分時四驅,二十五萬以內的頂配售價,這些特點都在表明途達是一款可以入門越野圈的新車;而且久經市場考驗的動力總成更讓它的可靠性有所保障,雖然內飾設計相對廉價,但是對於追求更多在嚴苛環境下有靠譜表現的消費者來說,途達的產品力正是他們想要的。

Jeep在中國市場上的發力趨勢愈發明顯,相繼自由光,指南者這類車型在國內市場獲得一定成功以後,現如今又推出了一款中國特供的中型SUV,大指揮官。雖然這款車型是一款低於大切諾基的中型SUV,但是它的外觀與內飾設計,配置供給與裝配工藝等等方面都基本上稱得上是現如今合資國產的Jeep車型中的旗艦。售價區間與漢蘭達,銳界等車型有着高度重合,未來中型7座SUV中的強有力競爭者勢必將會多出大指揮官的身影。

GLC和Q5在BBA的豪華中型SUV市場稱雄已久,操控大師寶馬也就看不過眼了,華晨寶馬X3正式在中國上市,都說它沒有加長會影響車內空間,但其實這款車型換代后本就有了一定車身尺寸上的增加,所以空間並不是什麼硬傷,相反,更原汁原味的引入國產化后的Q3勢必會成為BBA中型SUV中最具運動基因的一款車型,而廣大寶馬迷們在X3上市以後也必定有了更為接地氣和更實惠的車型備選方案。

怎麼樣,這幾款新SUV很吸引吧~

感興趣的話不妨去4S店看看實車噢本站聲明:網站內容來源於http://www.auto6s.com/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※網頁設計公司推薦不同的風格,搶佔消費者視覺第一線

※想知道購買電動車哪裡補助最多?台中電動車補助資訊懶人包彙整

※南投搬家公司費用,距離,噸數怎麼算?達人教你簡易估價知識!

※教你寫出一流的銷售文案?

※超省錢租車方案

未來一段時間開發的項目或者需求會大量使用到Redis,趁着這段時間業務並不太繁忙,抽點時間預習和複習Redis的相關內容。剛好看到博客下面的UV和PV統計,想到了最近看書裏面提到的HyperLogLog數據類型,於是花點時間分析一下它的使用方式和使用場景(暫時不探究HyperLogLog的實現原理)。Redis中HyperLogLog數據類型是Redid 2.8.9引入的,使用的時候確保Redis版本>= 2.8.9。

基數計數(cardinality counting),通常用來統計一個集合中不重複的元素個數。一個很常見的例子就是統計某個文章的UV(Unique Visitor,獨立訪客,一般可以理解為客戶端IP)。大數據量背景下,要實現基數計數,多數情況下不會選擇存儲全量的基數集合的元素,因為可以計算出存儲的內存成本,假設一個每個被統計的元素的平均大小為32bit,那麼如果統計一億個數據,佔用的內存大小為:

32 * 100000000 / 8 / 1024 / 1024 ≈ 381M。如果有多個集合,並且允許計算多個集合的合併計數結果,那麼這個操作帶來的複雜度可能是毀滅性的。因此,不會使用Bitmap、Tree或者HashSet等數據結構直接存儲計數元素集合的方式進行計數,而是在不追求絕對準確計數結果的前提之下,使用基數計數的概率算法進行計數,目前常見的有概率算法以下三種:

Linear Counting(LC)。LogLog Counting(LLC)。HyperLogLog Counting(HLL)。所以,HyperLogLog其實是一種基數計數概率算法,並不是Redis特有的,Redis基於C語言實現了HyperLogLog並且提供了相關命令API入口。

Redis的作者Antirez為了紀念Philippe Flajolet對組合數學和基數計算算法分析的研究,所以在設計HyperLogLog命令的時候使用了Philippe Flajolet姓名的英文首字母PF作為前綴。也就是說,Philippe Flajolet博士是HLL算法的重大貢獻者,但是他其實並不是Redis中HyperLogLog數據類型的開發者。遺憾的是Philippe Flajolet博士於2011年3月22日因病在巴黎辭世。這個是Philippe Flajolet博士的維基百科照片:

Redis提供的HyperLogLog數據類型的特徵:

HyperLogLog Counting(HLL)實現,只做基數計算,不會保存元數據。HyperLogLog每個KEY最多佔用12K的內存空間,可以計算接近2^64個不同元素的基數,它的存儲空間採用稀疏矩陣存儲,空間佔用很小,僅僅在計數基數個數慢慢變大,稀疏矩陣佔用空間漸漸超過了閾值時才會一次性轉變成稠密矩陣,轉變成稠密矩陣之後才會佔用12K的內存空間。Standard Error)為0.81%的近似值,當數據量不大的時候,得到的結果也可能是一個準確值。內存佔用小(每個KEY最高佔用12K)是HyperLogLog的最大優勢,而它存在兩個相對明顯的限制:

Redis提供的HyperLogLog數據類型一共有三個命令API:PFADD、PFCOUNT和PFMERGE。

PFADD命令參數如下:

PFADD key element [element …]

支持此命令的Redis版本是:>= 2.8.9

時間複雜度:每添加一個元素的複雜度為O(1)

element添加到鍵為key的HyperLogLog數據結構中。PFADD命令的執行流程如下:

PFADD命令的使用方式如下:

127.0.0.1:6379> PFADD food apple fish

(integer) 1

127.0.0.1:6379> PFADD food apple

(integer) 0

127.0.0.1:6379> PFADD throwable

(integer) 1

127.0.0.1:6379> SET name doge

OK

127.0.0.1:6379> PFADD name throwable

(error) WRONGTYPE Key is not a valid HyperLogLog string value.

雖然HyperLogLog數據結構本質是一個字符串,但是不能在String類型的KEY使用HyperLogLog的相關命令。

PFCOUNT命令參數如下:

PFCOUNT key [key …]

支持此命令的Redis版本是:>= 2.8.9

時間複雜度:返回單個HyperLogLog的基數計數值的複雜度為O(1),平均常數時間比較低。當參數為多個key的時候,複雜度為O(N),N為key的個數。

PFCOUNT命令使用單個key的時候,返回儲存在給定鍵的HyperLogLog數據結構的近似基數,如果鍵不存在, 則返回0。PFCOUNT命令使用多個key的時候,返回儲存在給定的所有HyperLogLog數據結構的並集的近似基數,也就是會把所有的HyperLogLog數據結構合併到一個臨時的HyperLogLog數據結構,然後計算出近似基數。PFCOUNT命令的使用方式如下:

127.0.0.1:6379> PFADD POST:1 ip-1 ip-2

(integer) 1

127.0.0.1:6379> PFADD POST:2 ip-2 ip-3 ip-4

(integer) 1

127.0.0.1:6379> PFCOUNT POST:1

(integer) 2

127.0.0.1:6379> PFCOUNT POST:1 POST:2

(integer) 4

127.0.0.1:6379> PFCOUNT NOT_EXIST_KEY

(integer) 0

PFMERGE命令參數如下:

PFMERGE destkey sourcekey [sourcekey ...]

支持此命令的Redis版本是:>= 2.8.9

時間複雜度:O(N),其中N為被合併的HyperLogLog數據結構的數量,此命令的常數時間比較高

HyperLogLog數據結構合併為一個新的鍵為destkey的HyperLogLog數據結構,合併后的HyperLogLog的基數接近於所有輸入HyperLogLog的可見集合(Observed Set)的並集的基數。OK。PFMERGE命令的使用方式如下

127.0.0.1:6379> PFADD POST:1 ip-1 ip-2

(integer) 1

127.0.0.1:6379> PFADD POST:2 ip-2 ip-3 ip-4

(integer) 1

127.0.0.1:6379> PFMERGE POST:1-2 POST:1 POST:2

OK

127.0.0.1:6379> PFCOUNT POST:1-2

(integer) 4

假設現在有個簡單的場景,就是統計博客文章的UV,要求UV的計數不需要準確,也不需要保存客戶端的IP數據。下面就這個場景,使用HyperLogLog做一個簡單的方案和編碼實施。

這個流程可能步驟的先後順序可能會有所調整,但是要做的操作是基本不變的。先簡單假設,文章的內容和統計數據都是後台服務返回的,兩個接口是分開設計。引入Redis的高級客戶端Lettuce依賴:

<dependency>

<groupId>io.lettuce</groupId>

<artifactId>lettuce-core</artifactId>

<version>5.2.1.RELEASE</version>

</dependency>

編碼如下:

public class UvTest {

private static RedisCommands<String, String> COMMANDS;

@BeforeClass

public static void beforeClass() throws Exception {

// 初始化Redis客戶端

RedisURI uri = RedisURI.builder().withHost("localhost").withPort(6379).build();

RedisClient redisClient = RedisClient.create(uri);

StatefulRedisConnection<String, String> connect = redisClient.connect();

COMMANDS = connect.sync();

}

@Data

public static class PostDetail {

private Long id;

private String content;

}

private PostDetail selectPostDetail(Long id) {

PostDetail detail = new PostDetail();

detail.setContent("content");

detail.setId(id);

return detail;

}

private PostDetail getPostDetail(String clientIp, Long postId) {

PostDetail detail = selectPostDetail(postId);

String key = "puv:" + postId;

COMMANDS.pfadd(key, clientIp);

return detail;

}

private Long getPostUv(Long postId) {

String key = "puv:" + postId;

return COMMANDS.pfcount(key);

}

@Test

public void testViewPost() throws Exception {

Long postId = 1L;

getPostDetail("111.111.111.111", postId);

getPostDetail("111.111.111.222", postId);

getPostDetail("111.111.111.333", postId);

getPostDetail("111.111.111.444", postId);

System.out.println(String.format("The uv count of post [%d] is %d", postId, getPostUv(postId)));

}

}

輸出結果:

The uv count of post [1] is 4

可以適當使用更多數量的不同客戶端IP調用getPostDetail(),然後統計一下誤差。

如果想要準確統計UV,則需要注意幾個點:

假設在不考慮內存成本的前提下,我們依然可以使用Redis做準確和實時的UV統計,簡單就可以使用Set數據類型,增加UV只需要使用SADD命令,統計UV只需要使用SCARD命令(時間複雜度為O(1),可以放心使用)。舉例:

127.0.0.1:6379> SADD puv:1 ip-1 ip-2

(integer) 2

127.0.0.1:6379> SADD puv:1 ip-3 ip-4

(integer) 2

127.0.0.1:6379> SCARD puv:1

(integer) 4

如果這些統計數據僅僅是用戶端展示,那麼可以採用異步設計:

在體量小的時候,上面的所有應用的功能可以在同一個服務中完成,消息隊列可以用線程池的異步方案替代。

這篇文章只是簡單介紹了HyperLogLog的使用和統計UV的使用場景。總的來說就是:在(1)原始數據量巨大,(2)內存佔用要求盡可能小,(3)允許計數存在一定誤差並且(4)不要求存放元數據的場景下,可以優先考慮使用HyperLogLog進行計數。

參考資料:

(本文完 c-3-d e-a-20191117)

技術公眾號(《Throwable文摘》),不定期推送筆者原創技術文章(絕不抄襲或者轉載):

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※教你寫出一流的銷售文案?

目錄

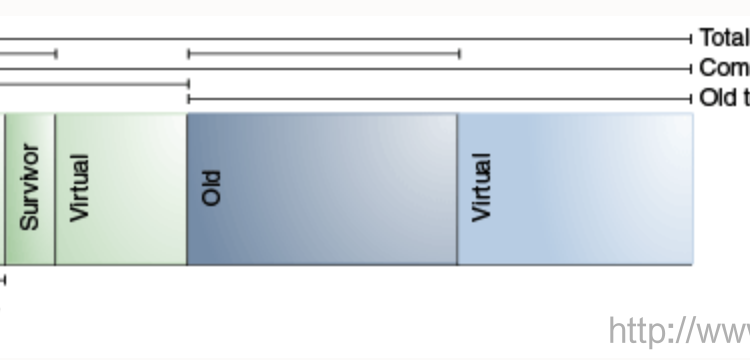

JVM的重要性不言而喻了,如果把java的應用程序比作一輛跑車,那麼JVM就是這輛車的發動機,沒有它,java程序就成了空中樓閣,無根浮萍。而在JVM中有一塊內存區域叫做運行時數據區域,存儲了運行時所需要的所有對象,而Heap Area則是其中最大的一塊。

內存畢竟不是無限的,所以就需要一種機制來將不再使用的對象進行回收,這種機制就是今天我們要講的GC。

更多精彩內容且看:

小師妹:F師兄,你相信這個世界有輪迴嗎?

師兄我是一個堅定的無神論者,活在當下就好了,何必操心後面的輪迴呢?

小師妹:F師兄,這個你就不懂了,意識是組成腦的原子群的一種組合模式,我們大腦的物質基礎和一塊石頭沒有什麼不同。當我們掌握大腦的組合方式,然後重構,我們的意識就重現了,這就是輪迴。這可是量子理論中提到的觀念哦。

哇,小師妹什麼時候這麼厲害了,都開始探討這麼高深的話題了。F師兄我實在是跟不上節奏啊。

小師妹,F師兄,我是怕你尷尬,想引出java對象的生命周期這個話題嘛。

量子理論我不熟,java對象我還沒怕過誰。

對象的生命周期其實很簡單:創建,使用中,最後被銷毀。

舉個最簡單的創建對象的例子:

Object obj = new Object();

對象創建的時候,將會為該對象分配特定的空間。

對象創建之後,就可以被其他的對象使用,如果其他的對象有使用該對象,那麼我們成為該對象被引用了。

當一個對象沒有被其他對象引用的時候,我們就稱為該對象可以被回收了。在Java中,對象的回收是由GC來負責的。

小師妹:F師兄,我覺得垃圾回收好像挺簡單的,我們為每個對象維持一個指針計數器,每引用一次就加一,這樣不就可以實現垃圾回收器了嗎?

底層原理是這麼一個道理,但是JVM需要一種更加高效的算法來保證垃圾回收的效率,同時也不會影響正在運行的程序。

接下來我們將會介紹一下,在JVM中比較常用幾個垃圾回收算法:

Mark and sweep是最最簡單的垃圾回收算法,簡單點講,它可以分為兩個步驟:

標記live對象聽起來很簡單,就是掃描堆中的對象,看這些對象是否被引入。

但是這裡有一個問題,如果是兩個對象互相引用的時候,而這兩個對象實際上並沒有被外部的對象所引用,那麼這兩個對象其實是應該被回收的。所以我們還需要解決一個關鍵性的問題:從哪裡開始掃描的問題。

JVM定義了一些Root對象,從這些對象開始,找出他們引用的對象,組成一個對象圖。所有在這個圖裡面的對象都是有效的對象,反之不在對象圖中的對象就應該被回收。有效的對象將會被Mark為alive。

這些Root對象包括:正在執行的方法中的本地對象和輸入參數。活動的線程,加載類中的static字段和JNI引用。

注意,這種遍歷其實是有個缺點的,因為為了找到對象圖中哪些對象是live的,必須暫停整個應用程序,讓對象變成靜止狀態,這樣才能構建有效的對象圖。後面我們會介紹更加有效的垃圾回收算法。

掃描對象之後,我們就可以將未標記的對象刪除了。

刪除有三種方式,第一種方式是正常刪除。但是正常刪除會導致內存碎片的產生。所以第二種方式就是刪除之後進行壓縮,以減少內存碎片。還有一種方式叫做刪除拷貝,也就是說將alive的對象拷貝到新的內存區域,這樣同樣可以解決內存碎片的問題。

在講CMS之前,我們先講一下垃圾回收器中的Eden,Old和Survivor space幾個大家應該都很熟悉的分代技術。

Young Gen被劃分為1個Eden Space和2個Suvivor Space。當對象剛剛被創建的時候,是放在Eden space。垃圾回收的時候,會掃描Eden Space和一個Suvivor Space。如果在垃圾回收的時候發現Eden Space中的對象仍然有效,則會將其複製到另外一個Suvivor Space。

就這樣不斷的掃描,最後經過多次掃描發現任然有效的對象會被放入Old Gen表示其生命周期比較長,可以減少垃圾回收時間。

之後要將的幾個垃圾回收器,除了ZGC,其他都使用的是分代的技術。

好了,現在繼續講CMS,CMS是mark and swap的升級版本,它使用多個線程來對heap區域進行掃描,從而提升效率。

CMS在Young Generation中使用的是mark-copy,而在Old Generation主要使用的是mark-sweep。

使用CMS的命令很簡單:

-XX:+UseConcMarkSweepGC

上面是列出的一些CMS的調優參數。

Serial garbage collection使用單一的線程來進行垃圾回收操作,其好處就是不需要和其他的線程進行交互。如果你是單核的CPU,那麼最好就是選擇Serial garbage collection,因為你不能充分利用多核的好處。同樣的它也常常用在比較小型的項目中。

Serial garbage collection在Young Generation中使用的是mark-copy,而在Old Generation主要使用的是 mark-sweep-compact。

下面是開啟命令:

-XX:+UseSerialGC

和serial GC類似,它在Young Generation中使用的是mark-copy,而在Old Generation主要使用的是 mark-sweep-compact。不同的是它是并行的。

可以通過下面的命令來指定併發的線程:

-XX:ParallelGCThreads=N

如果你是多核處理器,那麼Parallel GC可能是你的選擇。

Parallel GC是JDK8中的默認GC。而在JDK9之後, G1是默認的GC。

使用下面的命令來開啟Parallel GC:

-XX:+UseParallelGC

為什麼叫G1呢,G1=Garbage First,它是為替換CMS而生的,最早出現在java7中。

G1將heap區域劃分成為多個更小的區域,每個小區域都被標記成為young generation 或者old generation。從而運行GC在更小的範圍里運行,而不是影響整個heap區域。

可以使用下面的命令來開啟:

-XX:+UseG1GC

ZGC是一個可擴展的,低延遲的GC。ZGC是併發的,而且不需要停止正在運行的線程。

使用下面的命令來開啟:

-XX:+UseZGC

ZGC是在JDK11中被引入的。

小師妹:F師兄,你講了這麼多個GC,到底我該用哪個呢?

高射炮不能用來打蚊子,所以選擇合適的GC才是最終要的。這裏F師兄給你幾個建議:

如果你的應用程序內存本來就很小,那麼使用serial collector : -XX:+UseSerialGC.

如果你的程序運行在單核的CPU上,並且也沒有程序暫停時間的限制,那麼還是使用serial collector : -XX:+UseSerialGC.

如果對峰值期的性能要求比較高,但是對程序暫停時間沒多大的要求,那麼可以使用 parallel collector: -XX:+UseParallelGC。

如果更加關注響應時間,並且GC的對程序的暫停時間必須要小,那麼可以使用-XX:+UseG1GC。

如果響應時間非常重要,並且你在使用大容量的heap空間,那麼可以考慮使用ZGC: -XX:UseZGC。

本文介紹了幾種GC的算法,大家可以根據需要選用。

本文作者:flydean程序那些事

本文鏈接:http://www.flydean.com/jvm-gc-algorithms/

本文來源:flydean的博客

歡迎關注我的公眾號:程序那些事,更多精彩等着您!

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※網頁設計公司推薦不同的風格,搶佔消費者視覺第一線

※想知道購買電動車哪裡補助最多?台中電動車補助資訊懶人包彙整

※南投搬家公司費用,距離,噸數怎麼算?達人教你簡易估價知識!

※教你寫出一流的銷售文案?

※超省錢租車方案

前言:隨着國家工業2025戰略的推進,工業互聯網發展將會提速,將迎來一個新的發展時期,越來越多的企業開始逐步的把產線自動化,去年年底投產的小米亦庄的智能工廠就是一個熱議的新聞。小米/華為智能工廠只能說是中國製造2025的一個代表,產業轉型和製造升級,筆者從事的企業領域就越到越來越多的(製造)企業開始悄悄的自動化/智能化。這裏肯定有國家政策推動的大背景,同時,也有着企業自身不斷提高生產率的“剛需”。

本序列我們也從一個需求問題開始;然後,拆解需求(問題);其次,解決拆解需求(問題)的點;再次,通過的不斷技術摸索和迭代過程找到一個個合理的解決需求的方法和手段,最終,完成了這個需求(問題)的項目實戰。我們會在文中描述演化過程、方法論、過程保證機制和實用的工具等,最終帶着大家完成這樣一個實際項目需求的項目過程。項目涉及的Django的更多基礎知識請大家閱讀筆者早期的《Python開發入門與實戰系列》。

本文的過程採用python3.6和django2.1版本

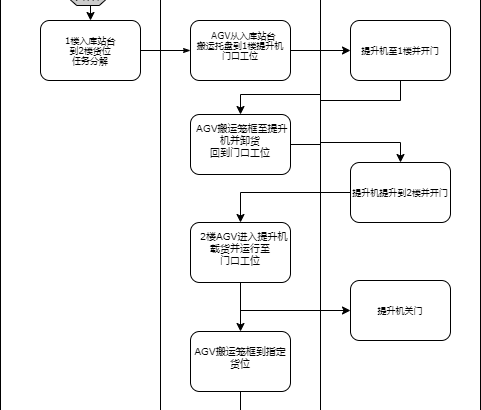

項目需求:這是一個簡版物流自動化倉庫實例,倉庫控制系統(以下簡稱WCS)需要調度AGV小車運送一個實托盤(搬運單元)從1樓入庫站台經由提升機搬運到2樓指定的倉庫貨位。

倉庫控制系統(以下簡稱WCS)需要調度AGV小車運送一個實托盤(搬運單元)從1樓入庫站台經由提升機搬運到2樓指定的倉庫貨位。這句簡要描述常常是我們在項目URS看到的需求描述,接下來我們需要對拿到的需求進行分析,形成一個個可度量的開發功能點。

需求用例說明文檔能夠很好的對需求進行詳細的分析,主要的包含內容包括:前置條件、事件流程和後置條件(執行結果)用例描述如下錶,通過用例分析我們能夠很好的把握需求的具體事件執行流程,並通過文檔清晰的描述出來,便於後期設計編碼時作為開發設計人員的指導。

經過團隊頭腦風暴討論,大家基本上達成了如下錶的需求用例說明,我們把這個調度設備的搬運過程設計成一個序列順序執行的步驟(子任務),這些子任務對應着設備的執行分解動作。

|

用例編碼 |

1.1 |

執行角色 |

WCS |

|

用例名稱 |

托盤入庫用例 |

||

|

前提條件 |

|

||

|

需求描述 |

1 WCS分解搬運任務成3個設備作業; 2 調度AGV從入庫站台搬運托盤到提升機1樓門口工位; 3 調度提升機到1樓並打開廊門; 4 調度AGV從提升機1樓門口工位到提升機並卸貨,返回提升機門口工位; 5 調度提升機1樓提升到2樓並開門; 6 調度AGV進入提升機並載貨搬運到2樓門口工位; 7 調度提升機關門; 8 調度AGV從2樓門口工位搬運到庫存貨位。 |

||

|

備選過程 |

|

||

|

擴展過程 |

|

||

|

原始需求描述 |

參見 《XXX URS》 |

||

|

特殊需求 |

無 |

||

|

後置條件 |

WCS調度相關設備完成實托盤從入庫站台搬運到庫存貨位,反饋結果給WMS |

||

從上面的用例說明的需求描述事件流程來看,我們需要先把這一趟搬運任務分解成設備子任務,並串行的方式順序下達到設備執行,任務清單如下錶:

|

序號 |

作業描述 |

執行設備 |

|

1 |

調度AGV從入庫站台搬運托盤到提升機1樓門口工位 |

1樓AGV |

|

2 |

調度提升機到1樓並打開門 |

提升機 |

|

3 |

調度AGV從提升機1樓門口工位到提升機並卸貨,返回提升機門口工位 |

1樓AGV |

|

4 |

調度提升機1樓提升到2樓並開門 |

提升機 |

|

5 |

調度AGV進入提升機並載貨搬運到2樓門口工位 |

2樓AGV |

|

6 |

調度提升機關門 |

提升機 |

|

7 |

調度AGV從2樓門口工位搬運到庫存貨位 |

2樓AGV |

也就是說這一趟搬運任務,WCS需要分解成7個設備作業子任務,並順序下達給相應的執行設備執行,最終完成任務的執行(當前的任務劃分粒度實際對接AGV和提升機廠家來說會有調整,最終以上步驟會依賴與實際對接的情況,但是主流程不會有太大變化)。

經過分析從1樓入庫站台運送托盤到二樓某個指定貨位這樣一個任務,系統需要分解成7個子任務,下達給設備順序執行。系統活動圖如下:

經過分析從1樓入庫站台運送托盤到2樓某個指定貨位這樣一個任務,系統需要分解成7個子任務,下達給設備順序執行。我們還可以通過UML活動圖來進一步詳細的描述作業的執行順序如下圖:

從圖中我們可以看出來一次入庫任務,系統分解為7個設備子任務(作業)來執行完整的托盤入庫流程,只有所有子任務(作業)執行完成,托盤的入庫才算完成。

對於這樣一個看似簡單的需求來說,包含兩大主要功能模塊

這裏也有幾個基本邏輯就是,設備在某一個時間點上只能執行一個子任務,只有這個任務執行完畢後方能下達新的子任務。多重任務邏輯只會導致設備無法完成任務(不知道到底該執行那個動作)。

我們從上面需求分析整理當前至少包括2個實體,包含的屬性(字段)如下:

1任務:

任務ID,任務號,源地址(從哪兒),目標地址(到哪兒),開始時間,結束時間,狀態

2子任務:

子任務ID,任務ID,源地址(從哪兒 上一個子任務的目標地址), 目標地址(到哪兒 下一個子任務的源地址), 執行機構,開始時間,結束時間,狀態

本章我們從一個需求問題開始,然後經過需求分析,把需求問題分解為功能點和數據實體,實體是下一步我們設計表或ORM model的基礎原型,上面的實體只是一個初步的需求分析主要字段要求,實體屬性(字段)會設計時會增加特定的其它屬性(字段)。 下一章節我們將描繪如何把這個需求逐步演化到模型設計。

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※網頁設計公司推薦不同的風格,搶佔消費者視覺第一線

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※南投搬家公司費用需注意的眉眉角角,別等搬了再說!

※教你寫出一流的銷售文案?

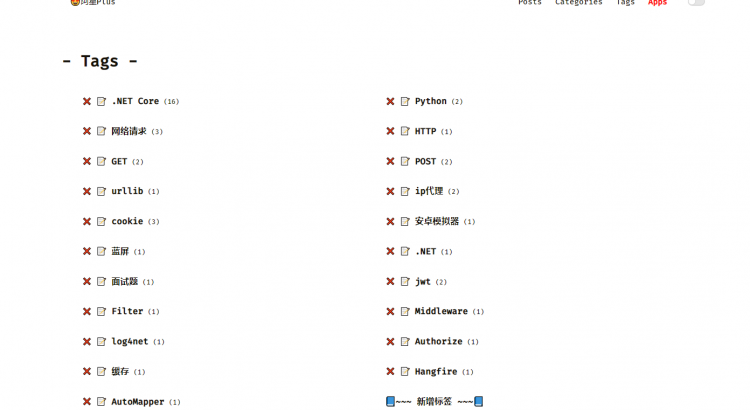

上一篇完成了後台分類模塊的所有功能,本篇繼續將標籤模塊和友情鏈接模塊的增刪改查完成。

實現方式和之前的分類管理是一樣的,在Admin文件夾下面添加Tags.razor組件,設置路由@page "/admin/tags"。

同樣的內容也需要放在AdminLayout組件下面,添加幾個參數:彈窗狀態bool Open、新增或更新時標籤字段string tagName, displayName、更新時的標籤Idint id、API返回的標籤列表接收參數ServiceResult<IEnumerable<QueryTagForAdminDto>> tags。

/// <summary>

/// 默認隱藏Box

/// </summary>

private bool Open { get; set; } = false;

/// <summary>

/// 新增或者更新時候的標籤字段值

/// </summary>

private string tagName, displayName;

/// <summary>

/// 更新標籤的Id值

/// </summary>

private int id;

/// <summary>

/// API返回的標籤列表數據

/// </summary>

private ServiceResult<IEnumerable<QueryTagForAdminDto>> tags;

//QueryTagForAdminDto.cs

namespace Meowv.Blog.BlazorApp.Response.Blog

{

public class QueryTagForAdminDto : QueryTagDto

{

/// <summary>

/// 主鍵

/// </summary>

public int Id { get; set; }

}

}

在初始化方法OnInitializedAsync()中獲取數據。

/// <summary>

/// 初始化

/// </summary>

/// <returns></returns>

protected override async Task OnInitializedAsync()

{

var token = await Common.GetStorageAsync("token");

Http.DefaultRequestHeaders.Add("Authorization", $"Bearer {token}");

tags = await FetchData();

}

/// <summary>

/// 獲取數據

/// </summary>

/// <returns></returns>

private async Task<ServiceResult<IEnumerable<QueryTagForAdminDto>>> FetchData()

{

return await Http.GetFromJsonAsync<ServiceResult<IEnumerable<QueryTagForAdminDto>>>("/blog/admin/tags");

}

注意需要設置請求頭,進行授權訪問,然後頁面上綁定數據。

<AdminLayout>

@if (tags == null)

{

<Loading />

}

else

{

<div class="post-wrap tags">

<h2 class="post-title">- Tags -</h2>

@if (tags.Success && tags.Result.Any())

{

<div class="categories-card">

@foreach (var item in tags.Result)

{

<div class="card-item">

<div class="categories">

<NavLink title="刪除" @onclick="@(async () => await DeleteAsync(item.Id))"></NavLink>

<NavLink title="編輯" @onclick="@(() => ShowBox(item))"></NavLink>

<NavLink target="_blank" href="@($"/tag/{item.DisplayName}")">

<h3>@item.TagName</h3>

<small>(@item.Count)</small>

</NavLink>

</div>

</div>

}

<div class="card-item">

<div class="categories">

<NavLink><h3 @onclick="@(() => ShowBox())">~~~ 新增標籤 ~~~</h3></NavLink>

</div>

</div>

</div>

}

else

{

<ErrorTip />

}

</div>

<Box OnClickCallback="@SubmitAsync" Open="@Open">

<div class="box-item">

<b>DisplayName:</b><input type="text" @bind="@displayName" @bind:event="oninput" />

</div>

<div class="box-item">

<b>TagName:</b><input type="text" @bind="@tagName" @bind:event="oninput" />

</div>

</Box>

}

</AdminLayout>

tags沒獲取到數據的時候显示<Loading />組件內容,循環遍曆數據進行綁定,刪除按鈕綁定點擊事件調用DeleteAsync()方法。新增和編輯按鈕點擊事件調用ShowBox()方法显示彈窗。新增的時候不需要傳遞參數,編輯的時候需要將當前item即QueryTagForAdminDto傳遞進去。

<Box>組件中綁定了標籤的兩個參數,是否打開參數Opne和確認按鈕回調事件方法SubmitAsync()。

刪除標籤的方法DeleteAsync(...)如下:

// 彈窗確認

bool confirmed = await Common.InvokeAsync<bool>("confirm", "\n真的要幹掉這個該死的標籤嗎");

if (confirmed)

{

var response = await Http.DeleteAsync($"/blog/tag?id={id}");

var result = await response.Content.ReadFromJsonAsync<ServiceResult>();

if (result.Success)

{

tags = await FetchData();

}

}

刪除之前進行二次確認,避免誤傷,刪除成功重新加載一遍數據。

彈窗的方法ShowBox(...)如下:

/// <summary>

/// 显示box,綁定字段

/// </summary>

/// <param name="dto"></param>

private void ShowBox(QueryTagForAdminDto dto = null)

{

Open = true;

id = 0;

// 新增

if (dto == null)

{

displayName = null;

tagName = null;

}

else // 更新

{

id = dto.Id;

displayName = dto.DisplayName;

tagName = dto.TagName;

}

}

最後在彈窗中確認按鈕的回調事件方法SubmitAsync()如下:

/// <summary>

/// 確認按鈕點擊事件

/// </summary>

/// <returns></returns>

private async Task SubmitAsync()

{

var input = new EditTagInput()

{

DisplayName = displayName.Trim(),

TagName = tagName.Trim()

};

if (string.IsNullOrEmpty(input.DisplayName) || string.IsNullOrEmpty(input.TagName))

{

return;

}

var responseMessage = new HttpResponseMessage();

if (id > 0)

responseMessage = await Http.PutAsJsonAsync($"/blog/tag?id={id}", input);

else

responseMessage = await Http.PostAsJsonAsync("/blog/tag", input);

var result = await responseMessage.Content.ReadFromJsonAsync<ServiceResult>();

if (result.Success)

{

tags = await FetchData();

Open = false;

}

}

輸入參數EditTagInput。

namespace Meowv.Blog.BlazorApp.Response.Blog

{

public class EditTagInput : TagDto

{

}

}

最終執行新增或者更新數據都在點擊事件中進行,將變量的值賦值給EditTagInput,根據id判斷走新增還是更新,成功后重新加載數據,關掉彈窗。

標籤管理頁面全部代碼如下:

點擊查看代碼

@page "/admin/categories"

<AdminLayout>

@if (categories == null)

{

<Loading />

}

else

{

<div class="post-wrap categories">

<h2 class="post-title">- Categories -</h2>

@if (categories.Success && categories.Result.Any())

{

<div class="categories-card">

@foreach (var item in categories.Result)

{

<div class="card-item">

<div class="categories">

<NavLink title="刪除" @onclick="@(async () => await DeleteAsync(item.Id))"></NavLink>

<NavLink title="編輯" @onclick="@(() => ShowBox(item))"></NavLink>

<NavLink target="_blank" href="@($"/category/{item.DisplayName}")">

<h3>@item.CategoryName</h3>

<small>(@item.Count)</small>

</NavLink>

</div>

</div>

}

<div class="card-item">

<div class="categories">

<NavLink><h3 @onclick="@(() => ShowBox())">~~~ 新增分類 ~~~</h3></NavLink>

</div>

</div>

</div>

}

else

{

<ErrorTip />

}

</div>

<Box OnClickCallback="@SubmitAsync" Open="@Open">

<div class="box-item">

<b>DisplayName:</b><input type="text" @bind="@displayName" @bind:event="oninput" />

</div>

<div class="box-item">

<b>CategoryName:</b><input type="text" @bind="@categoryName" @bind:event="oninput" />

</div>

</Box>

}

</AdminLayout>

@code {

/// <summary>

/// 默認隱藏Box

/// </summary>

private bool Open { get; set; } = false;

/// <summary>

/// 新增或者更新時候的分類字段值

/// </summary>

private string categoryName, displayName;

/// <summary>

/// 更新分類的Id值

/// </summary>

private int id;

/// <summary>

/// API返回的分類列表數據

/// </summary>

private ServiceResult<IEnumerable<QueryCategoryForAdminDto>> categories;

/// <summary>

/// 初始化

/// </summary>

/// <returns></returns>

protected override async Task OnInitializedAsync()

{

var token = await Common.GetStorageAsync("token");

Http.DefaultRequestHeaders.Add("Authorization", $"Bearer {token}");

categories = await FetchData();

}

/// <summary>

/// 獲取數據

/// </summary>

/// <returns></returns>

private async Task<ServiceResult<IEnumerable<QueryCategoryForAdminDto>>> FetchData()

{

return await Http.GetFromJsonAsync<ServiceResult<IEnumerable<QueryCategoryForAdminDto>>>("/blog/admin/categories");

}

/// <summary>

/// 刪除分類

/// </summary>

/// <param name="id"></param>

/// <returns></returns>

private async Task DeleteAsync(int id)

{

Open = false;

// 彈窗確認

bool confirmed = await Common.InvokeAsync<bool>("confirm", "\n真的要幹掉這個該死的分類嗎");

if (confirmed)

{

var response = await Http.DeleteAsync($"/blog/category?id={id}");

var result = await response.Content.ReadFromJsonAsync<ServiceResult>();

if (result.Success)

{

categories = await FetchData();

}

}

}

/// <summary>

/// 显示box,綁定字段

/// </summary>

/// <param name="dto"></param>

private void ShowBox(QueryCategoryForAdminDto dto = null)

{

Open = true;

id = 0;

// 新增

if (dto == null)

{

displayName = null;

categoryName = null;

}

else // 更新

{

id = dto.Id;

displayName = dto.DisplayName;

categoryName = dto.CategoryName;

}

}

/// <summary>

/// 確認按鈕點擊事件

/// </summary>

/// <returns></returns>

private async Task SubmitAsync()

{

var input = new EditCategoryInput()

{

DisplayName = displayName.Trim(),

CategoryName = categoryName.Trim()

};

if (string.IsNullOrEmpty(input.DisplayName) || string.IsNullOrEmpty(input.CategoryName))

{

return;

}

var responseMessage = new HttpResponseMessage();

if (id > 0)

responseMessage = await Http.PutAsJsonAsync($"/blog/category?id={id}", input);

else

responseMessage = await Http.PostAsJsonAsync("/blog/category", input);

var result = await responseMessage.Content.ReadFromJsonAsync<ServiceResult>();

if (result.Success)

{

categories = await FetchData();

Open = false;

}

}

}

實現方式都是一樣的,這個就不多說了,直接上代碼。

先將API返回的接收參數和新增編輯的輸入參數添加一下。

//QueryFriendLinkForAdminDto.cs

namespace Meowv.Blog.BlazorApp.Response.Blog

{

public class QueryFriendLinkForAdminDto : FriendLinkDto

{

/// <summary>

/// 主鍵

/// </summary>

public int Id { get; set; }

}

}

//EditFriendLinkInput.cs

namespace Meowv.Blog.BlazorApp.Response.Blog

{

public class EditFriendLinkInput : FriendLinkDto

{

}

}

@page "/admin/friendlinks"

<AdminLayout>

@if (friendlinks == null)

{

<Loading />

}

else

{

<div class="post-wrap categories">

<h2 class="post-title">- FriendLinks -</h2>

@if (friendlinks.Success && friendlinks.Result.Any())

{

<div class="categories-card">

@foreach (var item in friendlinks.Result)

{

<div class="card-item">

<div class="categories">

<NavLink title="刪除" @onclick="@(async () => await DeleteAsync(item.Id))"></NavLink>

<NavLink title="編輯" @onclick="@(() => ShowBox(item))"></NavLink>

<NavLink target="_blank" href="@item.LinkUrl">

<h3>@item.Title</h3>

</NavLink>

</div>

</div>

}

<div class="card-item">

<div class="categories">

<NavLink><h3 @onclick="@(() => ShowBox())">~~~ 新增友鏈 ~~~</h3></NavLink>

</div>

</div>

</div>

}

else

{

<ErrorTip />

}

</div>

<Box OnClickCallback="@SubmitAsync" Open="@Open">

<div class="box-item">

<b>Title:</b><input type="text" @bind="@title" @bind:event="oninput" />

</div>

<div class="box-item">

<b>LinkUrl:</b><input type="text" @bind="@linkUrl" @bind:event="oninput" />

</div>

</Box>

}

</AdminLayout>

@code {

/// <summary>

/// 默認隱藏Box

/// </summary>

private bool Open { get; set; } = false;

/// <summary>

/// 新增或者更新時候的友鏈字段值

/// </summary>

private string title, linkUrl;

/// <summary>

/// 更新友鏈的Id值

/// </summary>

private int id;

/// <summary>

/// API返回的友鏈列表數據

/// </summary>

private ServiceResult<IEnumerable<QueryFriendLinkForAdminDto>> friendlinks;

/// <summary>

/// 初始化

/// </summary>

/// <returns></returns>

protected override async Task OnInitializedAsync()

{

var token = await Common.GetStorageAsync("token");

Http.DefaultRequestHeaders.Add("Authorization", $"Bearer {token}");

friendlinks = await FetchData();

}

/// <summary>

/// 獲取數據

/// </summary>

/// <returns></returns>

private async Task<ServiceResult<IEnumerable<QueryFriendLinkForAdminDto>>> FetchData()

{

return await Http.GetFromJsonAsync<ServiceResult<IEnumerable<QueryFriendLinkForAdminDto>>>("/blog/admin/friendlinks");

}

/// <summary>

/// 刪除分類

/// </summary>

/// <param name="id"></param>

/// <returns></returns>

private async Task DeleteAsync(int id)

{

Open = false;

// 彈窗確認

bool confirmed = await Common.InvokeAsync<bool>("confirm", "\n真的要幹掉這個該死的分類嗎");

if (confirmed)

{

var response = await Http.DeleteAsync($"/blog/friendlink?id={id}");

var result = await response.Content.ReadFromJsonAsync<ServiceResult>();

if (result.Success)

{

friendlinks = await FetchData();

}

}

}

/// <summary>

/// 显示box,綁定字段

/// </summary>

/// <param name="dto"></param>

private void ShowBox(QueryFriendLinkForAdminDto dto = null)

{

Open = true;

id = 0;

// 新增

if (dto == null)

{

title = null;

linkUrl = null;

}

else // 更新

{

id = dto.Id;

title = dto.Title;

linkUrl = dto.LinkUrl;

}

}

/// <summary>

/// 確認按鈕點擊事件

/// </summary>

/// <returns></returns>

private async Task SubmitAsync()

{

var input = new EditFriendLinkInput()

{

Title = title.Trim(),

LinkUrl = linkUrl.Trim()

};

if (string.IsNullOrEmpty(input.Title) || string.IsNullOrEmpty(input.LinkUrl))

{

return;

}

var responseMessage = new HttpResponseMessage();

if (id > 0)

responseMessage = await Http.PutAsJsonAsync($"/blog/friendlink?id={id}", input);

else

responseMessage = await Http.PostAsJsonAsync("/blog/friendlink", input);

var result = await responseMessage.Content.ReadFromJsonAsync<ServiceResult>();

if (result.Success)

{

friendlinks = await FetchData();

Open = false;

}

}

}

截至目前為止,還剩下文章模塊的功能還沒做了,今天到這裏吧,明天繼續剛,未完待續…

開源地址:https://github.com/Meowv/Blog/tree/blog_tutorial

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※別再煩惱如何寫文案,掌握八大原則!

※教你寫出一流的銷售文案?

※超省錢租車方案

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※產品缺大量曝光嗎?你需要的是一流包裝設計!

閱讀本文大概需要 2 分鐘。

呼~~,每次過完一個周末,寫作就失去了動力,一两天才能緩過來。儘管如此,還是要堅持寫好每一篇文章的。寧缺毋濫嘛,寧願發文的頻率低一點,也要保證文章的質量,至少排版不能差,行文要流暢,錯別字不能有。

關於類型推導想必大家都很熟悉,它是在 var 關鍵字引入的時候引入 C# 的。

var i = 10;

var u = new User();

編譯器會通過右邊的字面量自動推導左邊變量的類型,這種推導方式可以歸納為:從上下文右邊推導出左邊的類型。我們不妨把它稱為源類型推導(Source-typed inferring,參考 Target-typed 自創的術語)。

相應的,有源類型推導就有目標類型推導 (Target-typed inferring),它是指從上下文左邊推導出右邊的類型。比如數組的初始化和 Lambda 表達式常常是目標類型推導的表達式。舉個例子:

// 沒有使用類型推導

string[] s = new string[] { "a", "b" };

// 目標類型推導(左推右)

string[] s = new { "a", "b" };

string[] s = new [] { "a", "b" };

// 沒有使用類型推導

Users.FirstOrDefault<User>(u => u.id = 123);

// 目標類型推導(左推右)

Users.FirstOrDefault(u => u.id = 123);

這次在 C# 9 中,增加了用戶定義類型 new 表達式的目標類型推導,即通過上下文左邊自動推導 new 表達式的類型,從而在使用 new 構造時省略類型的指定,請看示例:

// C# 9 之前

Point p = new Point(3, 5);

// C# 9

Point p = new (3, 5);

除此之外,C# 9 也增加了操作符 ?? 和 ?: 的目標類型推導支持。之前這兩個操作符必須要求兩邊的操作對象都是相同的類型,否則會編譯報錯。而在 C# 9 中,只要目標類型是操作對象共同的基類就不再會編譯報錯了,比如:

// Student 和 Customer 擁有共同的父類 Person

Person person = (Person)(student ?? customer); // C# 9 之前

Person person = student ?? customer; // C# 9

// 可空類型,0 和 null 都可以隱式轉換為 int? 類型

int? result = b ? 0 : (int?)null; // C# 9 之前

int? result = b ? 0 : null; // C# 9

其實本文的核心就一句代碼:

Point p = new (3, 5);

卻一不小心啰嗦了這麼一堆。但講真,學習新的知識不是要死記硬背,而要學會歸類推理,舉一反三,經常思考,最好能形成自己的一種思維習慣,這樣學習才會變成一件水到渠成的事。多看我的文章,希望你能學到的不僅僅是生硬的編程知識點,也希望我的行文風格和思維習慣對你有所啟發。

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※別再煩惱如何寫文案,掌握八大原則!

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※超省錢租車方案

※教你寫出一流的銷售文案?

※網頁設計最專業,超強功能平台可客製化

※產品缺大量曝光嗎?你需要的是一流包裝設計!

Hi,好久不見,我是CPU一號車間的阿Q,不認識我的話,可以看看:完了!CPU一味求快出事兒了!

真的是好久不見了,人類有個說法叫天上一天,地上一年,而在我們的世界里,人類一天,我們不知要過多少年~~

在我所在的CPU這座工廠里,時間的概念有些不太一樣。工廠大門外的中央廣場上掛着一個大大的鐘錶,整個計算機世界里的居民能夠掐着時間過日子全都仰仗它,你們人類把它叫做晶振。

這個鐘錶每隔66000000分之一秒就會報一次時,比人類的鐘錶不知道快到哪裡去了。

早些年還是夠用的,不過隨着我們CPU工廠生產效率的不斷提升,我們多次向晶振提出提升報時的精度,想讓他報時報的的更快一些,不過都被拒絕了。給我們的理由是內存那傢伙聯合主板上其他單位帶頭反對,說他們受條件限制,沒辦法像我們這麼快。

靠人不如靠己,為此,咱們工廠專門設立了一個叫倍頻器的部門進一步把這個報時細分,達到了3600000000分之1秒,作為我們工廠內部工作作息的時鐘周期,這数字實在是太長了,人類為了好記,取了一個叫主頻的名字,表示1秒鐘報時的次數,就是3.6GHz。

一不小心扯遠了,這次想給大家說一件事兒······

我們這座工廠的任務就是不斷的執行人類編寫的程序指令,咱廠里有8個車間,大家開足了馬力,就能同時執行8個線程,那速度那叫一個快。

可是廠里的老闆還是嫌我們不夠快,那天居然告訴我們要每個車間執行兩個線程,實現八核十六線程,是要把我們的勞動力壓榨到極致!我們都滿肚子怨言······

事情的起因是這樣的~~

有一次,我們一號車間的四人組趁着工作的空當,又鬥起了地主,突然領導過來視察。

“你們怎麼又在玩?是工作量不飽和嗎?”,見我們幾個閑着,領導一下就不高興了。

我趕緊上前解釋到:“不好意思領導,咱們剛剛執行了一條指令,需要內存中的一塊數據,剛好又不在緩存中,所以找內存那傢伙要數據去了,這不您也知道那傢伙向來很慢,我們閑着也是閑着所以就稍微放鬆了一下······”

聽了我的話領導一下皺起了眉頭,“還給我狡辯,廠里現在不是用上了亂序執行技術嗎?有這閑功夫你們可以先執行後面的指令啊”

“這我們當然知道,這不您看,我們把後面那幾條指令也都處理了,現在遇到了一條沒法提前執行的指令才停下來的”

領導看了一下問到:“為啥那條不能提前執行?”

“那是一個加法指令,加數依賴於現在正在處理的指令的運算結果呢,所以內存那傢伙不來消息,我們只能擱置着了”,我繼續解釋到。

領導聽完,一臉不高興的離開了。

過了幾天,領導又來到咱們一號車間來了,也不知道怎麼回事,這明明有八個車間,領導怎麼老愛往我們這邊跑。

不過這一次,我們沒有斗地主,正在辛辛苦苦的工作着。

當時,我正在執行一個浮點數運算,領導過來一看,拍了拍我的肩膀說到:“喲,阿Q,忙着吶,這是在做什麼啊?”

我笑着說到:“領導好,我剛剛用浮點數運算電路單元做了一個浮點數乘法,正在等待計算結果呢”

領導點了點頭,往周邊巡視一圈,指着一堆設備問到:“這一堆是什麼?”

“哦,那是整數運算電路單元,這條指令用不到它”

領導再次點了點頭,若有所思的離開了。

又過了幾天,廠里召開了一次會議,八個車間都派了代表參會。

會上,領導發話了:“前段時間我到各個車間視察,發現現在咱們廠里資源浪費的情況很嚴重!”

二號車間的虎子一聽就坐不住了,“領導,咱們大傢伙工作都挺賣力的,哪裡有浪費啊?”

領導瞥了一眼,繼續說到:“一方面,廠里的計算資源——電路設備得不到充分利用,另一方面,又因為內存讀取緩慢、指令依賴等方面的原因,浪費大家太多時間花在等待上”

八號車間的代表向來愛拍馬屁,接着領導的話問到:“領導是有什麼指示?我們八號車間絕對支持!”

“我們幾個管理層經過討論,決定讓你們一個車間由現在執行一個線程,變成執行兩個線程!”

領導這話一出,會場竊竊私語此起彼伏。虎子偏頭小聲對我說到:“這資本家改不了剝削的本色,這壓榨的也太狠了!”

領導咳嗽了幾聲,會場再次安靜了下來。

我起身問到:“領導,這咱們一個車間怎麼能執行兩個線程呢,每個車間的寄存器只有一套,這用起來豈不是要亂掉?”

“這個你不用擔心,我們會給每個車間配兩套寄存器!”

五號車間的代表一聽說到:“要不再給我們添點人手吧,這樣效率肯定提升快!”

領導一聽笑着說到:“還添人手?要不要再給你們添點運算設備?那我不如再增加幾個車間,還開這會幹嘛?這次會議的主題就是如何讓我們現有的資源得到最大程度的利用,減少浪費現象!”

會場一度陷入了尷尬又緊張的氛圍。

還是虎子打破了安靜,“領導,這兩個線程的工作該怎麼開展,我們心底沒有數啊!”

領導滿意的笑了一下:“這才是你們該問的問題嘛!每個車間回去重新分配一下工作,劃分為兩套班子,各自維護一套寄存器,對外宣稱你們是兩個不同的物理核心,但各車間的緩存和計算資源還是只有一套。你們內部協調好,在執行代碼指令的時候,充分利用等待的時間執行另一個線程的指令,這樣也不用擔心指令依賴的問題。”

大家一邊聽一邊做着筆記。

“還有,如果遇到資源閑置的情況,也可以同時執行兩個線程的指令。比如一個線程是執行整數運算指令,一個線程是執行浮點數運算指令,就可以一起來,讓工廠的計算資源充分用起來,別閑置。”

看我們都認真的記着筆記,領導露出了滿意的笑容,“都記好了吧,我們給這項革命性的技術取了個特別酷的名字,叫超線程技術!”

散會後,大家都紛紛抱怨,把大家逼得這麼緊,以後上班看來是沒法摸魚了,這日子真是越來越難過了。

不過,抱怨歸抱怨,大家還是得按照新規來執行。

很快,廠里就落地了這項技術,咱們一個車間搖身一變,變成了倆,咱們原來八核八線程的CPU一下變成了八核十六線程。操作系統那幫人都被我們給騙了,還以為咱們是十六核的CPU呢!

不過畢竟計算資源還是只有一份,遇到兩個線程都要使用同樣的計算單元時,還是得要排隊,還要花時間在兩個線程之前的協調工作上,所以整體工作效率的根本沒有2倍,絕大多數時候能提升個20%-30%就不錯了。

不僅如此,車間改造后,增加了新的邏輯電路單元,咱這CPU工廠的功耗也更大了,工廠門口那座巨大的風扇也得加大馬力給我們降溫了。

廠子里對這項技術的反對聲音開始不絕於耳。

不過後來發生了一件事,讓人們不得不關閉這項技術。聽聞這個消息,我們都樂開了花,看來又可以繼續摸魚了······

每當有網絡數據包到來,網卡那傢伙就通過中斷告訴我們CPU去處理。

可咱明明有8個車間,它非得一個勁的只給我們車間發中斷,搞得我們都沒法好好工作。

終於,我忍不住了······

預知後事如何,請關注後續精彩······

說明:

超線程技術出現時間其實早於多核技術。本故事僅為敘述方便,不代表二者真實的發展順序。

真慘!連各大編程語言都擺起地攤了!

因為一個跨域請求,我差點丟了飯碗

完了!CPU一味求快出事兒了!

哈希表哪家強?幾大編程語言吵起來了!

一個HTTP數據包的奇幻之旅

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※教你寫出一流的銷售文案?

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※回頭車貨運收費標準

※別再煩惱如何寫文案,掌握八大原則!

※超省錢租車方案

※產品缺大量曝光嗎?你需要的是一流包裝設計!

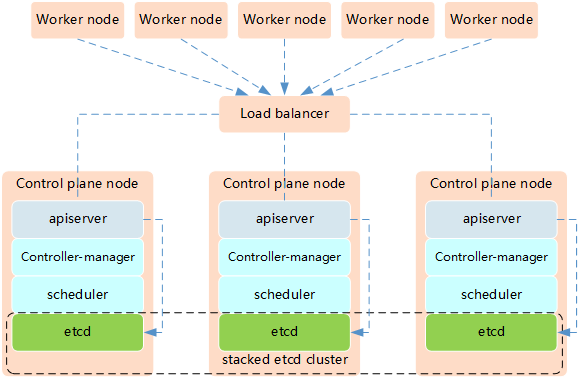

參考《附003.Kubeadm部署Kubernetes》。

參考《附003.Kubeadm部署Kubernetes》。

| 節點主機名 | IP | 類型 | 運行服務 |

|---|---|---|---|

| master01 | 172.24.8.71 | Kubernetes master節點 | docker、etcd、kube-apiserver、kube-scheduler、kube-controller-manager、 kubectl、kubelet、metrics、calico、HAProxy、KeepAlived |

| master02 | 172.24.8.72 | Kubernetes master節點 | docker、etcd、kube-apiserver、kube-scheduler、kube-controller-manager、 kubectl、kubelet、metrics、calico、HAProxy、KeepAlived |

| master03 | 172.24.8.73 | Kubernetes master節點 | docker、etcd、kube-apiserver、kube-scheduler、kube-controller-manager、 kubectl、kubelet、metrics、calico、HAProxy、KeepAlived |

| worker01 | 172.24.8.74 | Kubernetes node節點1 | docker、kubelet、proxy、calico |

| worker02 | 172.24.8.75 | Kubernetes node節點2 | docker、kubelet、proxy、calico |

| worker03 | 172.24.8.76 | Kubernetes node節點3 | docker、kubelet、proxy、calico |

| VIP | 172.24.8.100 |

Kubernetes的高可用主要指的是控制平面的高可用,即指多套Master節點組件和Etcd組件,工作節點通過負載均衡連接到各Master。

Kubernetes高可用架構中etcd與Master節點組件混布方式特點:

提示:本實驗使用Keepalived+HAProxy架構實現Kubernetes的高可用。

[root@master01 ~]# hostnamectl set-hostname master01 #其他節點依次修改

[root@master01 ~]# cat >> /etc/hosts << EOF

172.24.8.71 master01

172.24.8.72 master02

172.24.8.73 master03

172.24.8.74 worker01

172.24.8.75 worker02

172.24.8.76 worker03

EOF

[root@master01 ~]# vi k8sinit.sh

# Initialize the machine. This needs to be executed on every machine.

# Install docker

useradd -m docker

yum -y install yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum -y install docker-ce

mkdir /etc/docker

cat > /etc/docker/daemon.json <<EOF

{

"registry-mirrors": ["https://dbzucv6w.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

},

"storage-driver": "overlay2",

"storage-opts": [

"overlay2.override_kernel_check=true"

]

}

EOF

systemctl restart docker

systemctl enable docker

systemctl status docker

# Disable the SELinux.

sed -i 's/^SELINUX=.*/SELINUX=disabled/' /etc/selinux/config

# Turn off and disable the firewalld.

systemctl stop firewalld

systemctl disable firewalld

# Modify related kernel parameters & Disable the swap.

cat > /etc/sysctl.d/k8s.conf << EOF

net.ipv4.ip_forward = 1

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.tcp_tw_recycle = 0

vm.swappiness = 0

vm.overcommit_memory = 1

vm.panic_on_oom = 0

net.ipv6.conf.all.disable_ipv6 = 1

EOF

sysctl -p /etc/sysctl.d/k8s.conf >&/dev/null

swapoff -a

sed -i '/ swap / s/^\(.*\)$/#\1/g' /etc/fstab

modprobe br_netfilter

# Add ipvs modules

cat > /etc/sysconfig/modules/ipvs.modules <<EOF

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

modprobe -- nf_conntrack

EOF

chmod 755 /etc/sysconfig/modules/ipvs.modules

bash /etc/sysconfig/modules/ipvs.modules

# Install rpm

yum install -y conntrack ntpdate ntp ipvsadm ipset jq iptables curl sysstat libseccomp wget

# Update kernel

rpm --import http://down.linuxsb.com:8888/RPM-GPG-KEY-elrepo.org

rpm -Uvh http://down.linuxsb.com:8888/elrepo-release-7.0-4.el7.elrepo.noarch.rpm

yum --disablerepo="*" --enablerepo="elrepo-kernel" install -y kernel-ml

sed -i 's/^GRUB_DEFAULT=.*/GRUB_DEFAULT=0/' /etc/default/grub

grub2-mkconfig -o /boot/grub2/grub.cfg

yum update -y

# Reboot the machine.

# reboot

提示:對於某些特性,可能需要升級內核,內核升級操作見《018.Linux升級內核》。

4.19版及以上內核nf_conntrack_ipv4已經改為nf_conntrack。

為了更方便遠程分發文件和執行命令,本實驗配置master01節點到其它節點的 ssh 信任關係。

[root@master01 ~]# ssh-keygen -f ~/.ssh/id_rsa -N ''

[root@master01 ~]# ssh-copy-id -i ~/.ssh/id_rsa.pub root@master01

[root@master01 ~]# ssh-copy-id -i ~/.ssh/id_rsa.pub root@master02

[root@master01 ~]# ssh-copy-id -i ~/.ssh/id_rsa.pub root@master03

[root@master01 ~]# ssh-copy-id -i ~/.ssh/id_rsa.pub root@worker01

[root@master01 ~]# ssh-copy-id -i ~/.ssh/id_rsa.pub root@worker02

[root@master01 ~]# ssh-copy-id -i ~/.ssh/id_rsa.pub root@worker03

提示:此操作僅需要在master節點操作。

[root@master01 ~]# vi environment.sh

#!/bin/sh

#****************************************************************#

# ScriptName: environment.sh

# Author: xhy

# Create Date: 2020-05-30 16:30

# Modify Author: xhy

# Modify Date: 2020-06-15 17:55

# Version:

#***************************************************************#

# 集群 MASTER 機器 IP 數組

export MASTER_IPS=(172.24.8.71 172.24.8.72 172.24.8.73)

# 集群 MASTER IP 對應的主機名數組

export MASTER_NAMES=(master01 master02 master03)

# 集群 NODE 機器 IP 數組

export NODE_IPS=(172.24.8.74 172.24.8.75 172.24.8.76)

# 集群 NODE IP 對應的主機名數組

export NODE_NAMES=(worker01 worker02 worker03)

# 集群所有機器 IP 數組

export ALL_IPS=(172.24.8.71 172.24.8.72 172.24.8.73 172.24.8.74 172.24.8.75 172.24.8.76)

# 集群所有IP 對應的主機名數組

export ALL_NAMES=(master01 master02 master03 worker01 worker02 worker03)

[root@master01 ~]# source environment.sh

[root@master01 ~]# chmod +x *.sh

[root@master01 ~]# for all_ip in ${ALL_IPS[@]}

do

echo ">>> ${all_ip}"

scp -rp /etc/hosts root@${all_ip}:/etc/hosts

scp -rp k8sinit.sh root@${all_ip}:/root/

ssh root@${all_ip} "bash /root/k8sinit.sh"

done

需要在每台機器上都安裝以下的軟件包:

kubeadm不能安裝或管理 kubelet 或 kubectl ,所以得保證他們滿足通過 kubeadm 安裝的 Kubernetes 控制層對版本的要求。如果版本沒有滿足要求,可能導致一些意外錯誤或問題。

具體相關組件安裝見《附001.kubectl介紹及使用》。

提示:Kubernetes 1.18版本所有兼容相應組件的版本參考:https://github.com/kubernetes/kubernetes/blob/master/CHANGELOG/CHANGELOG-1.18.md。

[root@master01 ~]# for all_ip in ${ALL_IPS[@]}

do

echo ">>> ${all_ip}"

ssh root@${all_ip} "cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=1

repo_gpgcheck=1

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF"

ssh root@${all_ip} "yum install -y kubeadm-1.18.3-0.x86_64 kubelet-1.18.3-0.x86_64 kubectl-1.18.3-0.x86_64 --disableexcludes=kubernetes"

ssh root@${all_ip} "systemctl enable kubelet"

done

[root@master01 ~]# yum search -y kubelet --showduplicates #查看相應版本

提示:如上僅需Master01節點操作,從而實現所有節點自動化安裝,同時此時不需要啟動kubelet,初始化的過程中會自動啟動的,如果此時啟動了會出現報錯,忽略即可。

說明:同時安裝了cri-tools, kubernetes-cni, socat三個依賴:

socat:kubelet的依賴;

cri-tools:即CRI(Container Runtime Interface)容器運行時接口的命令行工具。

[root@master01 ~]# for master_ip in ${MASTER_IPS[@]}

do

echo ">>> ${master_ip}"

ssh root@${master_ip} "yum -y install gcc gcc-c++ make libnl libnl-devel libnfnetlink-devel openssl-devel wget openssh-clients systemd-devel zlib-devel pcre-devel libnl3-devel"

ssh root@${master_ip} "wget http://down.linuxsb.com:8888/software/haproxy-2.1.6.tar.gz"

ssh root@${master_ip} "tar -zxvf haproxy-2.1.6.tar.gz"

ssh root@${master_ip} "cd haproxy-2.1.6/ && make ARCH=x86_64 TARGET=linux-glibc USE_PCRE=1 USE_OPENSSL=1 USE_ZLIB=1 USE_SYSTEMD=1 PREFIX=/usr/local/haprpxy && make install PREFIX=/usr/local/haproxy"

ssh root@${master_ip} "cp /usr/local/haproxy/sbin/haproxy /usr/sbin/"

ssh root@${master_ip} "useradd -r haproxy && usermod -G haproxy haproxy"

ssh root@${master_ip} "mkdir -p /etc/haproxy && cp -r /root/haproxy-2.1.6/examples/errorfiles/ /usr/local/haproxy/"

done

[root@master01 ~]# for master_ip in ${MASTER_IPS[@]}

do

echo ">>> ${master_ip}"

ssh root@${master_ip} "yum -y install gcc gcc-c++ make libnl libnl-devel libnfnetlink-devel openssl-devel"

ssh root@${master_ip} "wget http://down.linuxsb.com:8888/software/keepalived-2.0.20.tar.gz"

ssh root@${master_ip} "tar -zxvf keepalived-2.0.20.tar.gz"

ssh root@${master_ip} "cd keepalived-2.0.20/ && ./configure --sysconf=/etc --prefix=/usr/local/keepalived && make && make install"

done

提示:如上僅需Master01節點操作,從而實現所有節點自動化安裝。

[root@master01 ~]# wget http://down.linuxsb.com:8888/hakek8s.sh #拉取自動部署腳本

[root@master01 ~]# chmod u+x hakek8s.sh

[root@master01 ~]# vi hakek8s.sh

#!/bin/sh

#****************************************************************#

# ScriptName: hakek8s.sh

# Author: xhy

# Create Date: 2020-06-08 20:00

# Modify Author: xhy

# Modify Date: 2020-06-15 18:15

# Version: v2

#***************************************************************#

#######################################

# set variables below to create the config files, all files will create at ./config directory

#######################################

# master keepalived virtual ip address

export K8SHA_VIP=172.24.8.100

# master01 ip address

export K8SHA_IP1=172.24.8.71

# master02 ip address

export K8SHA_IP2=172.24.8.72

# master03 ip address

export K8SHA_IP3=172.24.8.73

# master01 hostname

export K8SHA_HOST1=master01

# master02 hostname

export K8SHA_HOST2=master02

# master03 hostname

export K8SHA_HOST3=master03

# master01 network interface name

export K8SHA_NETINF1=eth0

# master02 network interface name

export K8SHA_NETINF2=eth0

# master03 network interface name

export K8SHA_NETINF3=eth0

# keepalived auth_pass config

export K8SHA_KEEPALIVED_AUTH=412f7dc3bfed32194d1600c483e10ad1d

# kubernetes CIDR pod subnet

export K8SHA_PODCIDR=10.10.0.0

# kubernetes CIDR svc subnet

export K8SHA_SVCCIDR=10.20.0.0

[root@master01 ~]# ./hakek8s.sh

解釋:如上僅需Master01節點操作。執行hakek8s.sh腳本後會生產如下配置文件清單:

[root@master01 ~]# cat kubeadm-config.yaml #檢查集群初始化配置

apiVersion: kubeadm.k8s.io/v1beta2

kind: ClusterConfiguration

networking:

serviceSubnet: "10.20.0.0/16" #設置svc網段

podSubnet: "10.10.0.0/16" #設置Pod網段

dnsDomain: "cluster.local"

kubernetesVersion: "v1.18.3" #設置安裝版本

controlPlaneEndpoint: "172.24.11.254:16443" #設置相關API VIP地址

apiServer:

certSANs:

- master01

- master02

- master03

- 127.0.0.1

- 192.168.2.11

- 192.168.2.12

- 192.168.2.13

- 192.168.2.200

timeoutForControlPlane: 4m0s

certificatesDir: "/etc/kubernetes/pki"

imageRepository: "k8s.gcr.io"

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

featureGates:

SupportIPVSProxyMode: true

mode: ipvs

提示:如上僅需Master01節點操作,更多config文件參考:https://godoc.org/k8s.io/kubernetes/cmd/kubeadm/app/apis/kubeadm/v1beta2。

此kubeadm部署初始化配置更多參考:https://pkg.go.dev/k8s.io/kubernetes/cmd/kubeadm/app/apis/kubeadm/v1beta2?tab=doc。

[root@master01 ~]# cat /etc/keepalived/keepalived.conf

[root@master01 ~]# cat /etc/keepalived/check_apiserver.sh 確認Keepalived配置

[root@master01 ~]# for master_ip in ${MASTER_IPS[@]}

do

echo ">>> ${master_ip}"

ssh root@${master_ip} "systemctl start haproxy.service && systemctl enable haproxy.service"

ssh root@${master_ip} "systemctl start keepalived.service && systemctl enable keepalived.service"

ssh root@${master_ip} "systemctl status keepalived.service | grep Active"

ssh root@${master_ip} "systemctl status haproxy.service | grep Active"

done

[root@master01 ~]# for all_ip in ${ALL_IPS[@]}

do

echo ">>> ${all_ip}"

ssh root@${all_ip} "ping -c1 172.24.8.100"

done #等待30s執行檢查

提示:如上僅需Master01節點操作,從而實現所有節點自動啟動服務。

[root@master01 ~]# kubeadm --kubernetes-version=v1.18.3 config images list #列出所需鏡像

[root@master01 ~]# cat config/downimage.sh #確認版本

#!/bin/sh

#****************************************************************#

# ScriptName: downimage.sh

# Author: xhy

# Create Date: 2020-05-29 19:55

# Modify Author: xhy

# Modify Date: 2020-06-10 19:15

# Version: v2

#***************************************************************#

KUBE_VERSION=v1.18.3

CALICO_VERSION=v3.14.1

CALICO_URL=calico

KUBE_PAUSE_VERSION=3.2

ETCD_VERSION=3.4.3-0

CORE_DNS_VERSION=1.6.7

GCR_URL=k8s.gcr.io

METRICS_SERVER_VERSION=v0.3.6

INGRESS_VERSION=0.32.0

CSI_PROVISIONER_VERSION=v1.4.0

CSI_NODE_DRIVER_VERSION=v1.2.0

CSI_ATTACHER_VERSION=v2.0.0

CSI_RESIZER_VERSION=v0.3.0

ALIYUN_URL=registry.cn-hangzhou.aliyuncs.com/google_containers

UCLOUD_URL=uhub.service.ucloud.cn/uxhy

QUAY_URL=quay.io

kubeimages=(kube-proxy:${KUBE_VERSION}

kube-scheduler:${KUBE_VERSION}

kube-controller-manager:${KUBE_VERSION}

kube-apiserver:${KUBE_VERSION}

pause:${KUBE_PAUSE_VERSION}

etcd:${ETCD_VERSION}

coredns:${CORE_DNS_VERSION}

metrics-server-amd64:${METRICS_SERVER_VERSION}

)

for kubeimageName in ${kubeimages[@]} ; do

docker pull $UCLOUD_URL/$kubeimageName

docker tag $UCLOUD_URL/$kubeimageName $GCR_URL/$kubeimageName

docker rmi $UCLOUD_URL/$kubeimageName

done

calimages=(cni:${CALICO_VERSION}

pod2daemon-flexvol:${CALICO_VERSION}

node:${CALICO_VERSION}

kube-controllers:${CALICO_VERSION})

for calimageName in ${calimages[@]} ; do

docker pull $UCLOUD_URL/$calimageName

docker tag $UCLOUD_URL/$calimageName $CALICO_URL/$calimageName

docker rmi $UCLOUD_URL/$calimageName

done

ingressimages=(nginx-ingress-controller:${INGRESS_VERSION})

for ingressimageName in ${ingressimages[@]} ; do

docker pull $UCLOUD_URL/$ingressimageName

docker tag $UCLOUD_URL/$ingressimageName $QUAY_URL/kubernetes-ingress-controller/$ingressimageName

docker rmi $UCLOUD_URL/$ingressimageName

done

csiimages=(csi-provisioner:${CSI_PROVISIONER_VERSION}

csi-node-driver-registrar:${CSI_NODE_DRIVER_VERSION}

csi-attacher:${CSI_ATTACHER_VERSION}

csi-resizer:${CSI_RESIZER_VERSION}

)

for csiimageName in ${csiimages[@]} ; do

docker pull $UCLOUD_URL/$csiimageName

docker tag $UCLOUD_URL/$csiimageName $QUAY_URL/k8scsi/$csiimageName

docker rmi $UCLOUD_URL/$csiimageName

done

[root@master01 ~]# for all_ip in ${ALL_IPS[@]}

do

echo ">>> ${all_ip}"

scp -rp config/downimage.sh root@${all_ip}:/root/

ssh root@${all_ip} "bash downimage.sh &"

done

提示:如上僅需Master01節點操作,從而實現所有節點自動拉取鏡像。

[root@master01 ~]# docker images #確認驗證

[root@master01 ~]# kubeadm init --config=kubeadm-config.yaml --upload-certs

You can now join any number of the control-plane node running the following command on each as root:

kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l \

--discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd \

--control-plane --certificate-key 560c926e508ed6011cd35fe120a5163d3ca32e16b745cf1877da970e3e0982f0

Please note that the certificate-key gives access to cluster sensitive data, keep it secret!

As a safeguard, uploaded-certs will be deleted in two hours; If necessary, you can use

"kubeadm init phase upload-certs --upload-certs" to reload certs afterward.

Then you can join any number of worker nodes by running the following on each as root:

kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l \

--discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd

注意:如上token具有默認24小時的有效期,token和hash值可通過如下方式獲取:

kubeadm token list

如果 Token 過期以後,可以輸入以下命令,生成新的 Token:

kubeadm token create

openssl x509 -pubkey -in /etc/kubernetes/pki/ca.crt | openssl rsa -pubin -outform der 2>/dev/null | openssl dgst -sha256 -hex | sed 's/^.* //'

[root@master01 ~]# mkdir -p $HOME/.kube

[root@master01 ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

[root@master01 ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config

[root@master01 ~]# cat << EOF >> ~/.bashrc

export KUBECONFIG=$HOME/.kube/config

EOF #設置KUBECONFIG環境變量

[root@master01 ~]# echo "source <(kubectl completion bash)" >> ~/.bashrc

[root@master01 ~]# source ~/.bashrc

附加:初始化過程大致步驟如下:

提示:初始化僅需要在master01上執行,若初始化異常可通過kubeadm reset && rm -rf $HOME/.kube重置。

[root@master02 ~]# kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l \

--discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd \

--control-plane --certificate-key 560c926e508ed6011cd35fe120a5163d3ca32e16b745cf1877da970e3e0982f0

[root@master02 ~]# mkdir -p $HOME/.kube

[root@master02 ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

[root@master02 ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config

[root@master02 ~]# cat << EOF >> ~/.bashrc

export KUBECONFIG=$HOME/.kube/config

EOF #設置KUBECONFIG環境變量

[root@master02 ~]# echo "source <(kubectl completion bash)" >> ~/.bashrc

[root@master02 ~]# source ~/.bashrc

提示:master03也如上執行添加至集群的controlplane。

提示:若添加異常可通過kubeadm reset && rm -rf $HOME/.kube重置。

[root@master01 ~]# kubectl taint nodes --all node-role.kubernetes.io/master- #允許master部署應用

提示:部署完內部應用后可使用kubectl taint node master01 node-role.kubernetes.io/master=””:NoSchedule重新設置Master為Master Only 狀態。

[root@master01 ~]# cat config/calico/calico.yaml #檢查配置

……

- name: CALICO_IPV4POOL_CIDR

value: "10.10.0.0/16" #檢查Pod網段

……

- name: IP_AUTODETECTION_METHOD

value: "interface=eth.*" #檢查節點之間的網卡

# Auto-detect the BGP IP address.

- name: IP

value: "autodetect"

……

[root@master01 ~]# kubectl apply -f config/calico/calico.yaml

[root@master01 ~]# kubectl get pods --all-namespaces -o wide #查看部署

[root@master01 ~]# kubectl get nodes

[root@master01 ~]# vi /etc/kubernetes/manifests/kube-apiserver.yaml

……

- --service-node-port-range=1-65535

……

提示:如上僅需在所有Master節點操作。

[root@master01 ~]# for node_ip in ${NODE_IPS[@]}

do

echo ">>> ${node_ip}"

ssh root@${node_ip} "kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l \

--discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd"

ssh root@${node_ip} "systemctl enable kubelet.service"

done

提示:如上僅需Master01節點操作,從而實現所有Worker節點添加至集群,若添加異常可通過如下方式重置:

[root@node01 ~]# kubeadm reset

[root@node01 ~]# ifconfig cni0 down

[root@node01 ~]# ip link delete cni0

[root@node01 ~]# ifconfig flannel.1 down

[root@node01 ~]# ip link delete flannel.1

[root@node01 ~]# rm -rf /var/lib/cni/

[root@master01 ~]# kubectl get nodes #節點狀態

[root@master01 ~]# kubectl get cs #組件狀態

[root@master01 ~]# kubectl get serviceaccount #服務賬戶

[root@master01 ~]# kubectl cluster-info #集群信息

[root@master01 ~]# kubectl get pod -n kube-system -o wide #所有服務狀態

提示:更多Kubetcl使用參考:https://kubernetes.io/docs/reference/kubectl/kubectl/

https://kubernetes.io/docs/reference/kubectl/overview/

更多kubeadm使用參考:https://kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/

Kubernetes的早期版本依靠Heapster來實現完整的性能數據採集和監控功能,Kubernetes從1.8版本開始,性能數據開始以Metrics API的方式提供標準化接口,並且從1.10版本開始將Heapster替換為Metrics Server。在Kubernetes新的監控體系中,Metrics Server用於提供核心指標(Core Metrics),包括Node、Pod的CPU和內存使用指標。

對其他自定義指標(Custom Metrics)的監控則由Prometheus等組件來完成。

有關聚合層知識參考:https://blog.csdn.net/liukuan73/article/details/81352637

kubeadm方式部署默認已開啟。

[root@master01 ~]# mkdir metrics

[root@master01 ~]# cd metrics/

[root@master01 metrics]# wget https://github.com/kubernetes-sigs/metrics-server/releases/download/v0.3.6/components.yaml

[root@master01 metrics]# vi components.yaml

……

apiVersion: apps/v1

kind: Deployment

……

spec:

replicas: 3 #根據集群規模調整副本數

……

spec:

hostNetwork: true

……

- name: metrics-server

image: k8s.gcr.io/metrics-server-amd64:v0.3.6

imagePullPolicy: IfNotPresent

args:

- --cert-dir=/tmp

- --secure-port=4443

- --kubelet-insecure-tls

- --kubelet-preferred-address-types=InternalIP,Hostname,InternalDNS,ExternalDNS,ExternalIP #追加此args

……

[root@master01 metrics]# kubectl apply -f components.yaml

[root@master01 metrics]# kubectl -n kube-system get pods -l k8s-app=metrics-server

NAME READY STATUS RESTARTS AGE

metrics-server-7b97647899-8txt4 1/1 Running 0 53s

metrics-server-7b97647899-btdwp 1/1 Running 0 53s

metrics-server-7b97647899-kbr8b 1/1 Running 0 53s

[root@k8smaster01 ~]# kubectl top nodes

[root@master01 metrics]# kubectl top pods --all-namespaces

提示:Metrics Server提供的數據也可以供HPA控制器使用,以實現基於CPU使用率或內存使用值的Pod自動擴縮容功能。

部署參考:https://linux48.com/container/2019-11-13-metrics-server.html

有關metrics更多部署參考:

https://kubernetes.io/docs/tasks/debug-application-cluster/resource-metrics-pipeline/

開啟開啟API Aggregation參考:

https://kubernetes.io/docs/concepts/extend-kubernetes/api-extension/apiserver-aggregation/

API Aggregation介紹參考:

https://kubernetes.io/docs/tasks/access-kubernetes-api/configure-aggregation-layer/

參考《附020.Nginx-ingress部署及使用》

[root@master01 ~]# kubectl label nodes master01 dashboard=yes

[root@master01 ~]# kubectl label nodes master02 dashboard=yes

[root@master01 ~]# kubectl label nodes master03 dashboard=yes

本實驗已獲取免費一年的證書,免費證書獲取可參考:https://freessl.cn。

[root@master01 ~]# mkdir -p /root/dashboard/certs

[root@master01 ~]# cd /root/dashboard/certs

[root@master01 certs]# mv k8s.odocker.com tls.crt

[root@master01 certs]# mv k8s.odocker.com tls.crt

[root@master01 certs]# ll

total 8.0K

-rw-r--r-- 1 root root 1.9K Jun 8 11:46 tls.crt

-rw-r--r-- 1 root root 1.7K Jun 8 11:46 tls.ke

提示:也可手動如下操作創建自簽證書:

[root@master01 ~]# openssl req -x509 -nodes -days 365 -newkey rsa:2048 -keyout tls.key -out tls.crt -subj "/C=CN/ST=ZheJiang/L=HangZhou/O=Xianghy/OU=Xianghy/CN=k8s.odocker.com"

[root@master01 ~]# kubectl create ns kubernetes-dashboard #v2版本dashboard獨立ns

[root@master01 ~]# kubectl create secret generic kubernetes-dashboard-certs --from-file=$HOME/dashboard/certs/ -n kubernetes-dashboard

[root@master01 ~]# kubectl get secret kubernetes-dashboard-certs -n kubernetes-dashboard -o yaml #查看新證書

NAME TYPE DATA AGE

kubernetes-dashboard-certs Opaque 2 4s

[root@master01 ~]# cd /root/dashboard

[root@master01 dashboard]# wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.1/aio/deploy/recommended.yaml

[root@master01 dashboard]# vi recommended.yaml

……

kind: Service

apiVersion: v1

metadata:

labels:

k8s-app: kubernetes-dashboard

name: kubernetes-dashboard

namespace: kubernetes-dashboard

spec:

type: NodePort #新增

ports:

- port: 443

targetPort: 8443

nodePort: 30001 #新增

selector:

k8s-app: kubernetes-dashboard

---

…… #如下全部註釋

#apiVersion: v1

#kind: Secret

#metadata:

# labels:

# k8s-app: kubernetes-dashboard

# name: kubernetes-dashboard-certs

# namespace: kubernetes-dashboard

#type: Opaque

……

kind: Deployment

……

replicas: 3 #適當調整為3副本

……

imagePullPolicy: IfNotPresent #修改鏡像下載策略

ports:

- containerPort: 8443

protocol: TCP

args:

- --auto-generate-certificates

- --namespace=kubernetes-dashboard

- --tls-key-file=tls.key

- --tls-cert-file=tls.crt

- --token-ttl=3600 #追加如上args

……

nodeSelector:

"beta.kubernetes.io/os": linux

"dashboard": "yes" #部署在master節點

……

kind: Service

apiVersion: v1

metadata:

labels:

k8s-app: dashboard-metrics-scraper

name: dashboard-metrics-scraper

namespace: kubernetes-dashboard

spec:

type: NodePort #新增

ports:

- port: 8000

nodePort: 30000 #新增

targetPort: 8000

selector:

k8s-app: dashboard-metrics-scraper

……

replicas: 3 #適當調整為3副本

……

nodeSelector:

"beta.kubernetes.io/os": linux

"dashboard": "yes" #部署在master節點

……

[root@master01 dashboard]# kubectl apply -f recommended.yaml

[root@master01 dashboard]# kubectl get deployment kubernetes-dashboard -n kubernetes-dashboard

[root@master01 dashboard]# kubectl get services -n kubernetes-dashboard

[root@master01 dashboard]# kubectl get pods -o wide -n kubernetes-dashboard

提示:master01 NodePort 30001/TCP映射到 dashboard pod 443 端口。

提示:dashboard v2版本默認沒有創建具有管理員權限的賬戶,可如下操作創建。

[root@master01 dashboard]# vi dashboard-admin.yaml

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: admin-user

namespace: kubernetes-dashboard

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: admin-user

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: admin-user

namespace: kubernetes-dashboard

[root@master01 dashboard]# kubectl apply -f dashboard-admin.yaml

[root@master01 ~]# cd /root/dashboard/certs

[root@master01 certs]# kubectl -n kubernetes-dashboard create secret tls kubernetes-dashboard-tls --cert=tls.crt --key=tls.key

[root@master01 certs]# kubectl -n kubernetes-dashboard describe secrets kubernetes-dashboard-tls

[root@master01 ~]# cd /root/dashboard/

[root@master01 dashboard]# vi dashboard-ingress.yaml

apiVersion: networking.k8s.io/v1beta1

kind: Ingress

metadata:

name: kubernetes-dashboard-ingress

namespace: kubernetes-dashboard

annotations:

kubernetes.io/ingress.class: "nginx"

nginx.ingress.kubernetes.io/use-regex: "true"

nginx.ingress.kubernetes.io/ssl-passthrough: "true"

nginx.ingress.kubernetes.io/rewrite-target: /

nginx.ingress.kubernetes.io/ssl-redirect: "true"

#nginx.ingress.kubernetes.io/secure-backends: "true"

nginx.ingress.kubernetes.io/backend-protocol: "HTTPS"

nginx.ingress.kubernetes.io/proxy-connect-timeout: "600"

nginx.ingress.kubernetes.io/proxy-read-timeout: "600"

nginx.ingress.kubernetes.io/proxy-send-timeout: "600"

nginx.ingress.kubernetes.io/configuration-snippet: |

proxy_ssl_session_reuse off;

spec:

rules:

- host: k8s.odocker.com

http:

paths:

- path: /

backend:

serviceName: kubernetes-dashboard

servicePort: 443

tls:

- hosts:

- k8s.odocker.com

secretName: kubernetes-dashboard-tls

[root@master01 dashboard]# kubectl apply -f dashboard-ingress.yaml

[root@master01 dashboard]# kubectl -n kubernetes-dashboard get ingress

將k8s.odocker.com導入瀏覽器,並設置為信任,導入操作略。

使用token相對複雜,可將token添加至kubeconfig文件中,使用KubeConfig文件訪問dashboard。

[root@master01 dashboard]# ADMIN_SECRET=$(kubectl -n kubernetes-dashboard get secret | grep admin-user | awk '{print $1}')

[root@master01 dashboard]# DASHBOARD_LOGIN_TOKEN=$(kubectl describe secret -n kubernetes-dashboard ${ADMIN_SECRET} | grep -E '^token' | awk '{print $2}')

[root@master01 dashboard]# kubectl config set-cluster kubernetes \

--certificate-authority=/etc/kubernetes/pki/ca.crt \

--embed-certs=true \

--server=172.24.8.100:16443 \

--kubeconfig=local-hakek8s-dashboard-admin.kubeconfig # 設置集群參數

[root@master01 dashboard]# kubectl config set-credentials dashboard_user \

--token=${DASHBOARD_LOGIN_TOKEN} \

--kubeconfig=local-hakek8s-dashboard-admin.kubeconfig # 設置客戶端認證參數,使用上面創建的 Token

[root@master01 dashboard]# kubectl config set-context default \

--cluster=kubernetes \

--user=dashboard_user \

--kubeconfig=local-hakek8s-dashboard-admin.kubeconfig # 設置上下文參數

[root@master01 dashboard]# kubectl config use-context default --kubeconfig=local-hakek8s-dashboard-admin.kubeconfig # 設置默認上下文

本實驗採用ingress所暴露的域名:https://k8s.odocker.com 方式訪問。

使用local-hakek8s-dashboard-admin.kubeconfig文件訪問:

提示:更多dashboard訪問方式及認證可參考 《附004.Kubernetes Dashboard簡介及使用》。

dashboard登錄整個流程可參考:https://www.cnadn.net/post/2613.html

Longhorn是用於Kubernetes的開源分佈式塊存儲系統。

提示:更多介紹參考:https://github.com/longhorn/longhorn。

[root@master01 ~]# source environment.sh

[root@master01 ~]# for all_ip in ${ALL_IPS[@]}

do

echo ">>> ${all_ip}"

ssh root@${all_ip} "yum -y install iscsi-initiator-utils &"

done

提示:所有節點都需要安裝。

[root@master01 ~]# mkdir longhorn

[root@master01 ~]# cd longhorn/

[root@master01 longhorn]# wget \

https://raw.githubusercontent.com/longhorn/longhorn/master/deploy/longhorn.yaml

[root@master01 longhorn]# vi longhorn.yaml

#……

---

kind: Service

apiVersion: v1

metadata:

labels:

app: longhorn-ui

name: longhorn-frontend

namespace: longhorn-system

spec:

type: NodePort #修改為nodeport

selector:

app: longhorn-ui

ports:

- port: 80

targetPort: 8000

nodePort: 30002

---

……

kind: DaemonSet

……

imagePullPolicy: IfNotPresent

……

#……

[root@master01 longhorn]# kubectl apply -f longhorn.yaml

[root@master01 longhorn]# kubectl -n longhorn-system get pods -o wide

提示:若部署異常可刪除重建,若出現無法刪除namespace,可通過如下操作進行刪除:

wget https://github.com/longhorn/longhorn/blob/master/uninstall/uninstall.yaml

rm -rf /var/lib/longhorn/

kubectl apply -f uninstall.yaml

kubectl delete -f longhorn.yaml

提示:默認longhorn部署完成已創建一個sc,也可通過如下手動編寫yaml創建。

[root@master01 longhorn]# kubectl get sc

NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE ALLOWVOLUMEEXPANSION AGE

……

longhorn driver.longhorn.io Delete Immediate true 15m

[root@master01 longhorn]# vi longhornsc.yaml

kind: StorageClass

apiVersion: storage.k8s.io/v1

metadata:

name: longhornsc

provisioner: rancher.io/longhorn

parameters:

numberOfReplicas: "3"

staleReplicaTimeout: "30"

fromBackup: ""

[root@master01 longhorn]# kubectl create -f longhornsc.yaml

[root@master01 longhorn]# vi longhornpod.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: longhorn-pvc

spec:

accessModes:

- ReadWriteOnce

storageClassName: longhorn

resources:

requests:

storage: 2Gi

---

apiVersion: v1

kind: Pod

metadata:

name: longhorn-pod

namespace: default

spec:

containers:

- name: volume-test

image: nginx:stable-alpine

imagePullPolicy: IfNotPresent

volumeMounts:

- name: volv

mountPath: /data

ports:

- containerPort: 80

volumes:

- name: volv

persistentVolumeClaim:

claimName: longhorn-pvc

[root@master01 longhorn]# kubectl apply -f longhornpod.yaml

[root@master01 longhorn]# kubectl get pods

[root@master01 longhorn]# kubectl get pvc

[root@master01 longhorn]# kubectl get pv

[root@master01 longhorn]# yum -y install httpd-tools

[root@master01 longhorn]# htpasswd -c auth xhy #創建用戶名和密碼

提示:也可通過如下命令創建:USER=xhy; PASSWORD=x120952576; echo "${USER}:$(openssl passwd -stdin -apr1 <<< ${PASSWORD})" >> auth

[root@master01 longhorn]# kubectl -n longhorn-system create secret generic longhorn-basic-auth --from-file=auth [root@master01 longhorn]# vi longhorn-ingress.yaml #創建ingress規則

apiVersion: networking.k8s.io/v1beta1

kind: Ingress

metadata:

name: longhorn-ingress

namespace: longhorn-system

annotations:

nginx.ingress.kubernetes.io/auth-type: basic

nginx.ingress.kubernetes.io/auth-secret: longhorn-basic-auth

nginx.ingress.kubernetes.io/auth-realm: 'Authentication Required '

spec:

rules:

- host: longhorn.odocker.com

http:

paths:

- path: /

backend:

serviceName: longhorn-frontend

servicePort: 80

[root@master01 longhorn]# kubectl apply -f longhorn-ingress.yaml

瀏覽器訪問:longhorn.odocker.com,並輸入賬號和密碼。

參考《053.集群管理-Helm工具》。

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※超省錢租車方案

※別再煩惱如何寫文案,掌握八大原則!

※回頭車貨運收費標準

※教你寫出一流的銷售文案?

※產品缺大量曝光嗎?你需要的是一流包裝設計!

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益